Quand l’intelligence artificielle hérite de nos préjugés : comprendre et agir

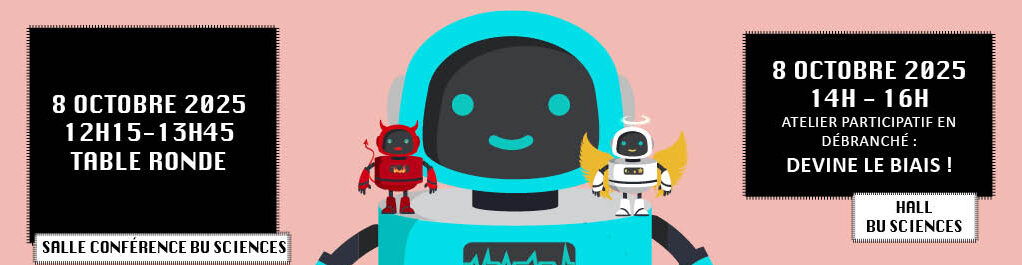

Événement : Mercredi 8 octobre de 12h15 à 13h45

Invitées

Genoveva Vargas Solar, CNRS, LIRIS (modératrice)

- Houleymatou Baldé, Association Yeeso

- Nelly Barret, INSA Lyon, LIRIS

- Aurélie Olivier, Université Lyon 1, Laboratoire ELICO

- Jey Puget Gil, University of Lyon 1, LIRIS

- John Samuel, CPE, Université de Lyon, LIRIS

Déroulé de l’événement

- 12h15 : Accueil et présentation de la mission égalité-diversité – Aurélie Olivesi

- 12h20 : présentation de l’événement et des intervenant·es – Genoveva Vargas-Solar

- 12h25 – 13h15 : Table ronde [Slides]

Pour ouvrir la discussion

- Avez-vous déjà entendu dire qu’une IA pouvait être “biaisée” ? Qu’est-ce que cela vous évoque ?

- Pensez-vous qu’un ordinateur ou un robot puisse être “injuste” ? Pourquoi ?

Comprendre simplement

- Est-ce que les machines pensent par elles-mêmes ? Ou est-ce nous qui leur apprenons ?

- Comment un algorithme peut-il apprendre un stéréotype sans qu’on le veuille ?

- Est-ce que ce sont les données, les programmeurs, ou la société qui sont à l’origine des biais ?

Rendre concret

- Peut-on donner des exemples de discriminations causées par l’IA dans la vraie vie ?

- Est-ce que ces erreurs touchent tout le monde de la même façon ? Pourquoi certaines personnes sont-elles plus concernées ?

Agir ensemble

- Que peut-on faire pour éviter ces injustices ? Est-ce que l’IA peut être “corrigée” ?

- Quelles sont les bonnes idées ou projets qui cherchent à rendre l’IA plus équitable ?

- En tant que citoyennes et citoyens, que pouvons-nous revendiquer ou surveiller ?

13h15 – 13h45 : Questions de la salle